Đơn vị xử lý thần kinh

Tìm hiểu định nghĩa và chức năng của Bộ xử lý thần kinh (NPU).

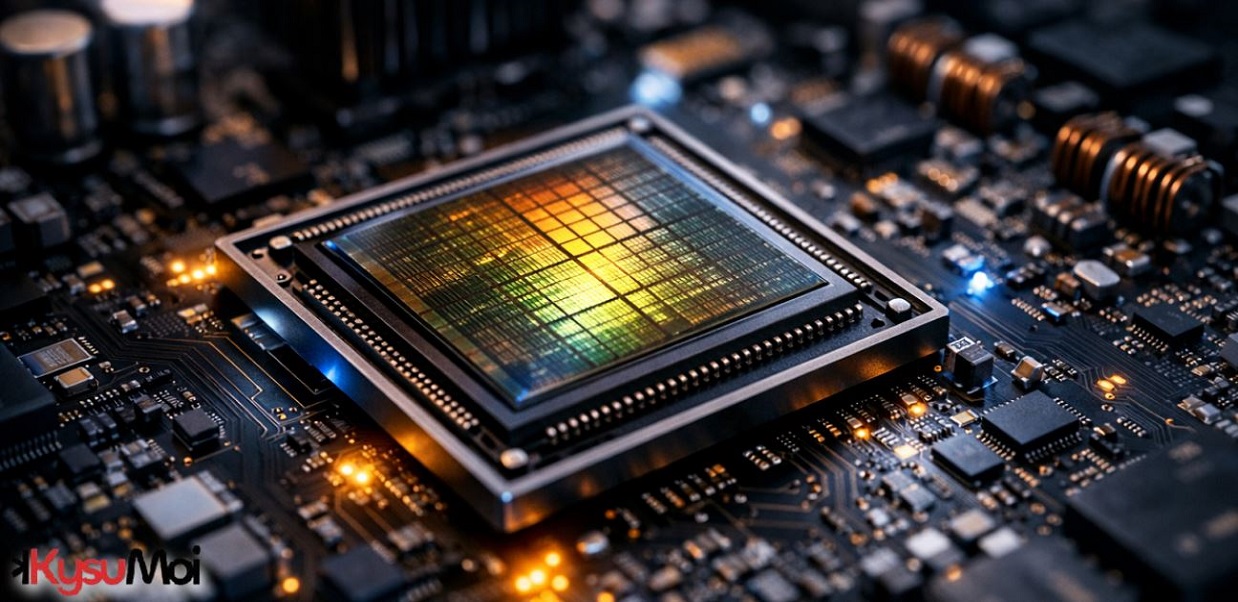

Bộ xử lý thần kinh (NPU) là gì?

Bộ xử lý thần kinh (NPU) là một bộ vi xử lý máy tính chuyên dụng được thiết kế để bắt chước các chức năng xử lý của não người. Các tác vụ và ứng dụng machine learning

Không giống như các đơn vị xử lý trung tâm (CPU) hoặc đơn vị xử lý đồ họa (GPU) thông thường, NPU được tối ưu hóa để tăng tốc các tác vụ và khối lượng công việc AI, chẳng hạn như tính toán lớp mạng nơ-ron được tạo thành từ toán học vô hướng. Vectơ và Tensor

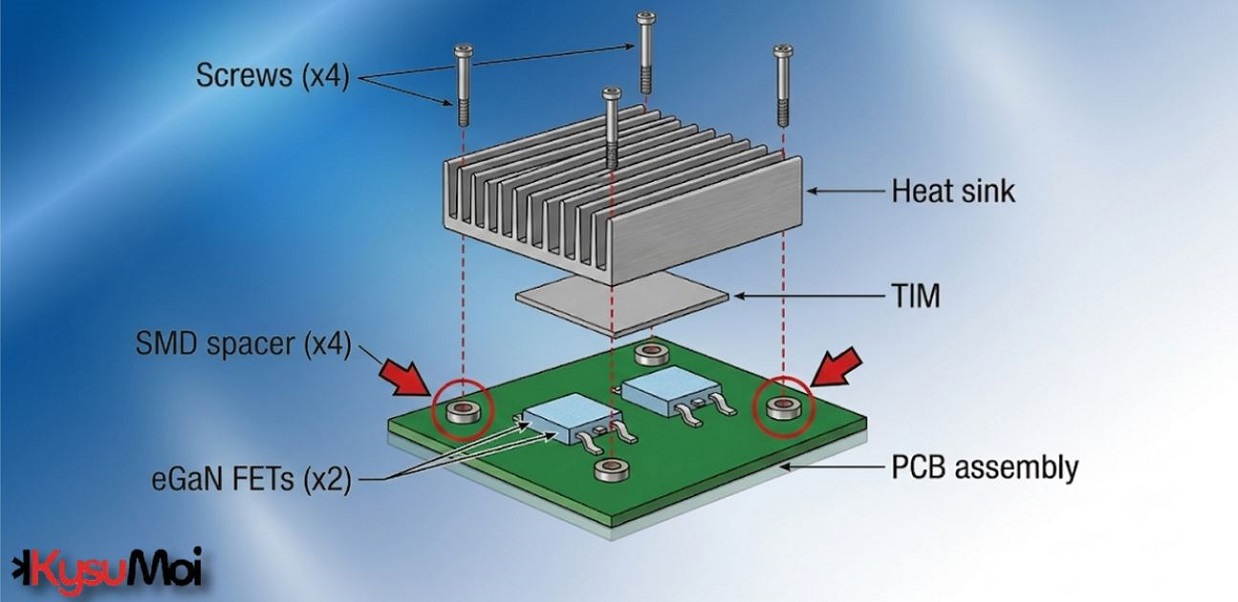

NPU, còn được gọi là chip AI hoặc bộ tăng tốc AI, thường được sử dụng trong các kiến trúc điện toán không đồng nhất tích hợp nhiều bộ xử lý (chẳng hạn như CPU và GPU). Tuy nhiên, hầu hết các ứng dụng tiêu dùng, chẳng hạn như điện thoại thông minh, thiết bị di động và máy tính xách tay, có xu hướng tích hợp NPU với các bộ đồng xử lý khác trên một vi mạch bán dẫn duy nhất được gọi là hệ thống trên chip (SoC).

Với tích hợp NPU chuyên dụng Do đó, các nhà sản xuất có thể cung cấp các ứng dụng AI tổng quát trên các thiết bị có thể xử lý các ứng dụng AI, khối lượng công việc AI và thuật toán học máy trong thời gian thực với mức tiêu thụ điện năng tương đối thấp và thông lượng cao.

Các tính năng chính của NPU

Đơn vị xử lý thần kinh (NPU) lý tưởng cho các tác vụ yêu cầu điện toán song song có độ trễ thấp, chẳng hạn như xử lý thuật toán học sâu. Nhận dạng giọng nói Xử lý ngôn ngữ tự nhiên, xử lý ảnh và video và phát hiện đối tượng

Các tính năng chính của NPU bao gồm:

- Xử lý song song: NPU Các vấn đề lớn có thể được chia thành các thành phần để giải quyết đa nhiệm, cho phép bộ xử lý chạy đồng thời nhiều hoạt động mạng nơ-ron.

- Số học có độ chính xác thấp: NPU thường hỗ trợ các phép toán 8 bit (hoặc thấp hơn) để đơn giản hóa các phép tính và tăng hiệu quả sử dụng năng lượng.

- Bộ nhớ băng thông cao: NPU Nhiều thiết bị có bộ nhớ băng thông cao trên chip để thực hiện hiệu quả xử lý AI yêu cầu bộ dữ liệu lớn.

- Tăng tốc phần cứng: Những tiến bộ trong thiết kế NPU đã dẫn đến việc kết hợp các kỹ thuật tăng tốc phần cứng như kiến trúc mảng tâm thu hoặc xử lý tensor được cải thiện.

NPU Nó hoạt động như thế nào?

Bộ xử lý thần kinh (NPU) hoạt động bằng cách dựa vào mạng nơ-ron của não. Nó mô phỏng hành vi của các tế bào thần kinh và khớp thần kinh của con người ở lớp mạch. Điều này cho phép xử lý một loạt các hướng dẫn học sâu, một trong số đó hoàn thành quá trình xử lý một tập hợp các tế bào thần kinh ảo.

Không giống như các bộ xử lý truyền thống, NPU không được xây dựng để tính toán chính xác, nhưng NPU được xây dựng đặc biệt cho các chức năng giải quyết vấn đề và có thể được phát triển liên tục bằng cách học từ các loại dữ liệu và đầu vào khác nhau. Không còn lập trình thủ công.

Một tính năng đặc biệt của NPU là khả năng xử lý song song vượt trội và khả năng tăng tốc hoạt động của AI thông qua các lõi dung lượng cao đơn giản, loại bỏ nhu cầu về nhiều loại tác vụ. Chức năng kích hoạt Thao tác và giải nén dữ liệu 2D Mô-đun nhân và cộng cụ thể này được sử dụng cho các hoạt động liên quan đến xử lý các ứng dụng mạng nơ-ron, chẳng hạn như tính toán ma trận nhân và cộng, tích chập, v.v. Hệ số điểm và các hàm khác.

Trong khi các bộ xử lý truyền thống yêu cầu hàng nghìn lệnh để hoàn thành loại xử lý tế bào thần kinh này, NPU có thể hoàn thành các hoạt động tương tự với một lệnh duy nhất. Ngoài ra, NPU tích hợp lưu trữ và tính toán dữ liệu thông qua trọng số khớp thần kinh. Đây là một biến tính toán linh hoạt được gán cho một nút mạng, cho biết xác suất của một kết quả "đúng" hoặc "mong muốn" có thể được sửa đổi hoặc "học" bất cứ lúc nào. Dẫn đến năng suất tốt hơn

Mặc dù sự phát triển NPU tiếp tục phát triển, nhưng các thử nghiệm cho thấy hiệu suất của một số NPU tốt hơn 100 lần so với các GPU tương đương, với cùng mức tiêu thụ điện năng.

Những ưu điểm chính của NPU

Các đơn vị xử lý thần kinh (NPU) không được thiết kế hoặc dự kiến sẽ thay thế CPU và GPU truyền thống. Tuy nhiên, Kiến trúc của NPU đã phát triển thiết kế của cả hai bộ xử lý để đạt được khả năng xử lý song song và học máy vượt trội. Kết hợp với CPU và GPU, nó mang lại một số lợi thế đáng kể so với các hệ thống truyền thống.

Những ưu điểm chính là như sau:

- Xử lý song song: Như đã đề cập, NPU có thể chia nhỏ các vấn đề chính thành các thành phần khác nhau để giải quyết các vấn đề đa nhiệm. Điểm mấu chốt là mặc dù GPU nổi bật trong xử lý song song, nhưng cấu trúc độc đáo của chúng có thể hoạt động tốt hơn so với GPU tương đương. Tiêu thụ ít năng lượng hơn và kích thước diện tích sử dụng nhỏ hơn.

- Cải thiện hiệu suất: Mặc dù GPU thường được sử dụng cho các tác vụ điện toán và AI hiệu suất cao, nhưng NPU có thể thực hiện xử lý song song tương tự với hiệu suất năng lượng tốt hơn nhiều. Khi AI và các điện toán hiệu suất cao khác ngày càng trở nên phổ biến và đòi hỏi nhiều năng lượng hơn, NPU cung cấp một giải pháp có giá trị để giảm mức tiêu thụ điện năng đáng kể.

- Xử lý dữ liệu đa phương tiện thời gian thực: NPU Được thiết kế để xử lý và phản hồi nhiều loại dữ liệu đầu vào hơn, bao gồm hình ảnh, video và âm thanh. Áp dụng NPU để nâng cao các ứng dụng như rô-bốt Thiết bị, Internet vạn vật (IoT) và thiết bị đeo cho phép phản hồi theo thời gian thực. Đơn giản hóa công việc và cung cấp phản hồi và giải pháp quan trọng khi thời gian phản hồi là quan trọng nhất.

NPU GPU so với CPU so với CPU

Trong thế giới khoa học máy tính cổ điển, bộ xử lý trung tâm (CPU) được coi là "bộ não" của máy tính.

Từ những năm 1950 đến những năm 1990, CPU là thiết bị chịu trách nhiệm xử lý hầu hết các máy tính. Kiểm soát hệ thống và quản lý đầu vào/đầu ra (I/O)

Nhưng với sự ra đời của trò chơi máy tính cá nhân và thiết kế có sự hỗ trợ của máy tính (CAD) vào những năm 1980, ngành công nghiệp cần các giải pháp nhanh hơn và hiệu quả hơn để hiển thị đồ họa máy tính.

Đơn vị Trong khi GPU thường sử dụng ít lõi hơn để thực hiện các hoạt động tuyến tính, GPU có hàng trăm đến hàng nghìn lõi, có thể được xử lý song song, một quá trình trong đó các tác vụ lớn được chia thành các vấn đề nhỏ có thể được giải quyết đồng thời với nhiều bộ xử lý và / hoặc lõi.

GPU ban đầu được phát triển để hỗ trợ xử lý video và hình ảnh. Mặc dù GPU không phải là loại bộ xử lý duy nhất có thể thực hiện xử lý song song hoặc xử lý song song, nhưng chúng lý tưởng cho điện toán song song. Tuy nhiên, GPU cũng có những hạn chế và thường yêu cầu mức tiêu thụ điện năng rất cao để thực hiện các tác vụ đòi hỏi hiệu suất cao hơn.

Nó tích hợp và cải thiện khả năng xử lý song song tiên tiến của GPU, do đó mang lại hiệu suất cao với mức tiêu thụ điện năng thấp hơn (và lợi thế bổ sung là kích thước dấu chân vật lý nhỏ hơn).

So sánh bộ xử lý

- Bộ xử lý trung tâm: "Bộ não" của máy tính CPU thường phân bổ khoảng 70% bóng bán dẫn bên trong của chúng để tạo bộ nhớ đệm và chúng là một phần của bộ điều khiển của máy tính. CPU có số lượng lõi tương đối nhỏ. Nó sử dụng kiến trúc điện toán nối tiếp cho các giải pháp tuyến tính và được thiết kế để điều khiển logic chính xác.

- GPU có nhiều lõi hơn CPU và sử dụng hầu hết các bóng bán dẫn của chúng để tạo ra nhiều đơn vị xử lý, mỗi đơn vị có độ phức tạp xử lý thấp, cho phép xử lý song song nâng cao.

- Đơn vị xử lý thần kinh: Đơn vị xử lý trung tâm (NPU) được phát triển trên quá trình xử lý song song của GPU bằng cách sử dụng kiến trúc máy tính được thiết kế để mô phỏng các tế bào thần kinh trong não người. Để mang lại hiệu suất hiệu suất cao, NPU sử dụng trọng lượng khớp thần kinh để tích hợp các chức năng lưu trữ và tính toán bộ nhớ. Trong khi CPU được thiết kế để xử lý tuyến tính chính xác, NPU được xây dựng cho máy học. Kết quả là, đa nhiệm Xử lý song song và khả năng điều chỉnh và tùy chỉnh các hoạt động bất cứ lúc nào mà không cần lập trình thêm.

Các trường hợp sử dụng NPU

Bởi vì nó là một công nghệ mới đã xuất hiện. Nhiều nhà sản xuất máy tính và phần cứng hàng đầu, bao gồm Microsoft, Intel, Nvidia, Qualcomm và Samsung, cung cấp các đơn vị xử lý thần kinh (NPU) độc lập hoặc tích hợp, chẳng hạn như Apple Neural Engine.

Sự ra đời của NPU trong các thiết bị điện tử tiêu dùng có nhiều lợi ích, chẳng hạn như nhận thức hình ảnh tốt hơn và tùy chỉnh tốt hơn các camera dựa trên AI để làm mờ nền trong các cuộc gọi video. Các ứng dụng bổ sung cho NPU bao gồm:

Trí tuệ nhân tạo và các mô hình ngôn ngữ lớn

Là một loại bộ tăng tốc AI, NPU được tạo ra để cải thiện hiệu suất của các hệ thống AI và ML như mạng nơ-ron. Hoạt động song song nâng cao của NPU giống như tăng cường GPU, cung cấp sự phát triển đáng kể cho các mô hình ngôn ngữ lớn yêu cầu xử lý thích ứng có độ trễ thấp để diễn giải tín hiệu đa phương tiện. Nó thực hiện nhận dạng giọng nói, đồng thời tạo ra ngôn ngữ và nghệ thuật tự nhiên được sử dụng trong các công cụ như chatbot AI và các ứng dụng hình ảnh và video AI. Trực quan hóa

Thiết bị Internet vạn vật (IoT)

Với khả năng xử lý song song và khả năng tự học vượt trội, NPU lý tưởng cho các thiết bị IoT nối mạng như thiết bị đeo, trợ lý giọng nói và thiết bị thông minh.

Trung tâm dữ liệu

AI và máy học rất có lợi cho các trung tâm dữ liệu muốn tối ưu hóa việc sử dụng tài nguyên năng lượng.

Xe không người lái

Các phương tiện tự lái, chẳng hạn như máy bay không người lái, hoặc ô tô và xe tải tự lái, được hưởng lợi rất nhiều từ khả năng xử lý thời gian thực của NPU, cho phép điều chỉnh tuyến đường nhanh hơn và tốt hơn dựa trên dữ liệu từ các cảm biến đa phương tiện. Với khả năng xử lý song song vô song, NPU có thể giúp các phương tiện tự hành nhanh chóng giải thích và xử lý dữ liệu đang phát triển, chẳng hạn như biển báo giao thông. Mô hình giao thông, và thậm chí cả những chướng ngại vật bất ngờ.

Xử lý biên và AI

Trong khi điện toán đám mây cung cấp các giải pháp tài nguyên và dữ liệu tại chỗ tiên tiến cho IoT, thiết bị thông minh và các thiết bị điện toán cá nhân khác, điện toán biên và AI biên là những giải pháp duy nhất có thể được sử dụng để cải thiện chất lượng dữ liệu. Nó nhằm mục đích đưa dữ liệu quan trọng và tài nguyên máy tính đến gần hơn với người dùng. Điều này làm giảm độ trễ, giảm mức tiêu thụ điện năng và tăng cường quyền riêng tư của NPU, tiêu thụ ít điện năng hơn và nhỏ hơn. Nó đang trở thành một yếu tố thiết yếu trong điện toán biên và AI biên trên các thiết bị.

Rô-bốt

Với chuyên môn trong việc quản lý các nhiệm vụ đòi hỏi học máy và thị giác máy tính, NPU đóng góp đáng kể cho sự phát triển của ngành công nghiệp robot. Robot dựa trên AI, từ trợ lý gia đình đến dụng cụ phẫu thuật tự động, tất cả đều dựa vào NPU để cải thiện khả năng phát hiện của chúng. Học hỏi và ứng phó với môi trường.